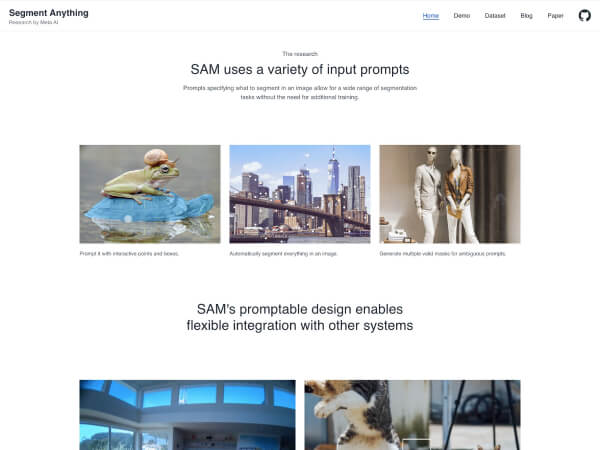

「Segment Anything」是什么

Segment Anything(SAM)是Meta AI推出的全新AI模型,能在任何图像中一键“剪出”任何物体。它是可提示的分割系统,对陌生物体和图像具备零样本泛化能力,无需额外训练,为图像处理带来创新变革。

功能解析

- 多种输入提示:可通过交互式点和框提示,也能自动分割图像中所有内容,还能为模糊提示生成多个有效掩码。

- 灵活集成:能接收其他系统输入提示,如未来可接收AR/VR头戴设备中用户的注视来选择物体。

- 可扩展输出:输出掩码可作为其他AI系统输入,用于视频物体跟踪、图像编辑等多种任务。

产品特色

- 零样本泛化:已学习物体通用概念,无需额外训练就能对陌生物体和图像进行零样本泛化处理。

- 高效灵活模型设计:模型分为一次性图像编码器和轻量级掩码解码器,后者能在浏览器中快速运行。

- 强大的数据支持:通过“数据引擎”在数百万图像和掩码上训练,最终数据集包含超1100万个分割掩码。

应用场景

- 图像编辑场景:用户在进行图像创作时,需精准选取特定物体进行编辑。以往手动选取耗时费力且不准确,SAM可一键分割出所需物体,提高编辑效率和质量。

- 创意设计场景:设计师在进行创意拼贴等设计时,需要快速获取各种物体素材。SAM能快速分割图像中的物体,为设计师提供丰富素材。

技术原理解析

- 模型结构:由ViT-H图像编码器、提示编码器和轻量级基于变压器的掩码解码器组成。

- 运行平台:图像编码器用PyTorch实现,需GPU高效推理;提示编码器和掩码解码器可直接用PyTorch或转换为ONNX,在多种平台运行。

使用指南

首先选择合适输入提示方式,如交互式点、框等;然后运行模型进行图像分割;最后获取输出掩码用于后续任务。

鄂公网安备42010402001699号

鄂公网安备42010402001699号