在AI技术不断演进的当下,多模态发展成为重要趋势。此前DeepSeek自家的Janus-Pro-7B未结合推理能力,而如今国内有新进展。北大联合港科大团队基于自研全模态框架Align-Anything,推出了多模态版DeepSeek-R1——Align-DS-V ,在部分视觉理解表现评测集上超越[GPT-4](https://ai-kit.cn/sites/1023.html)o。

研究人员在让DeepSeek-R1“长眼睛”的过程中,有了重要发现,即模态穿透对于模型文本模态推理能力具有提升效果。多模态训练后,模型在文本模态任务以及科学任务、复杂推理、数学代码等方面的表现均有提升,在ARC-Challenge(5-shot)上成绩显著提高。基于此,团队认为当下多模态大模型已具备强大的跨模态穿透与融合的感知能力。

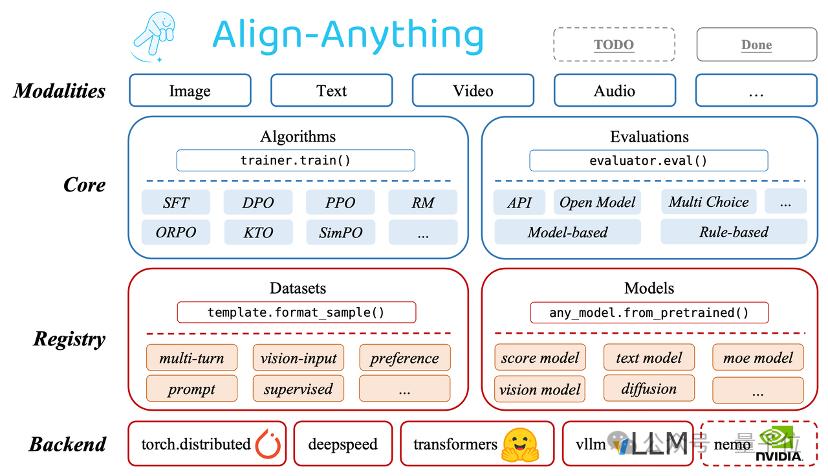

人类日常接收的信息是全模态的,将“强推理慢思考”推广到更多模态甚至全模态场景是趋势,同时全模态大模型与人类意图对齐是挑战。为应对这些,研究团队提出Align-Anything框架,致力于使全模态大模型与人类意图和价值观对齐。该框架具有高度模块化、支持跨任意模态模型的微调、支持不同的对齐方法、支持多种开、闭源对齐评估等特点。团队还发布首个全模态人类偏好数据集Align-Anything。

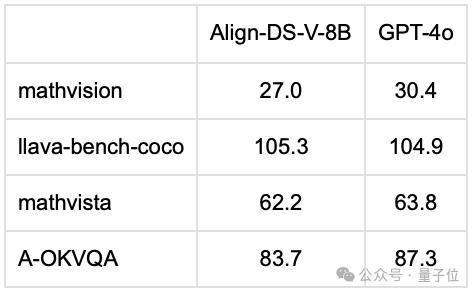

团队攻坚多模态场景加持下的Deepseek-R1表现,借鉴LLaVA训练思路,在Align-Anything库中开源训练全部流程。训练分成两步,成功后将多模态版本的DeepSeek-R1系列模型命名为Align-DS-V。Align-DS-V在部分评测集上表现超过GPT-4o,且展现出模态穿透对模型能力提升的效果,其能力突破单一模态局限,跨模态穿透深度显著提升。

为验证全模态推理大模型垂域应用能力,研发团队对Align-DS-V进行本地化对齐,使其适应混合语言输入,在图文数学问题中表现出色。Align-Anything和Align-DS-V由北京大学联合香港科技大学开发,均已开源并将长期维护。北大-灵初联合实验室还将在视觉语言动作模型领域做更深度探索 。

鄂公网安备42010402001699号

鄂公网安备42010402001699号